Article modifié le 19 septembre 2024

Une récente étude sur le marché des interfaces vocales a mis en exergue un certain nombre de limitations empêchant les Amazon Echo et Google Home d’être les remplaçants tant attendus des smartphones et autres télécommandes. Pour l’instant !

Nul doute que les interactions vocales entre l’homme et la machine viendront à l’avenir, si ce n’est remplacer, mais au moins compléter activement les interfaces physiques que l’on connaît aujourd’hui. Le raz-de-marée tant annoncé de l’Amazon Echo, 5 millions d’exemplaires pourtant déjà vendus, ne représente qu’un balbutiement sur le marché potentiel du contrôle par la voix.

La quasi totalité des commandes vocales ne survivent pas plus de 2 semaines

L’étude Voice Report 2017 nous apprend par exemple qu’une application vocale installée sur l’Amazon Echo est délaissée dans 97% des cas au bout de quinze jours. La raison en est simple : l’assistant vocal n’a pas d’écran. On oublie donc les applications (skills) installées et les commandes à sa disposition. Cela demande un effort de mémoire en totale contradiction avec la simplicité d’une interface non physique. Le smartphone avec ses petites icônes reste donc une interface bien plus pratique à ce jour.

Entre 11 et 13% des applications mobiles sont encore utilisées après 2 semaines ; ce chiffre tombe à 3% pour les applications vocales.

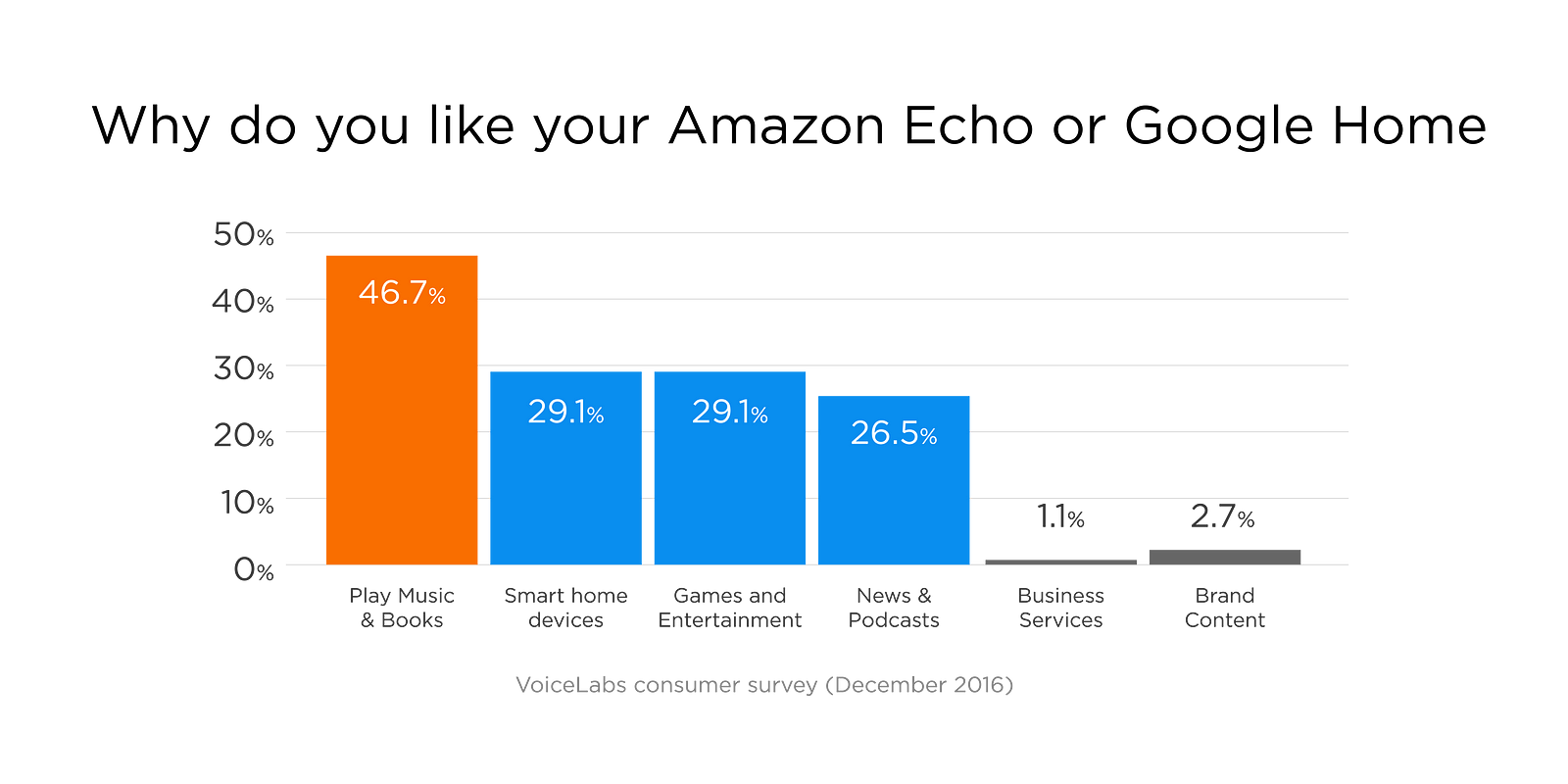

Les utilisateurs de l’Amazon Echo se contentent de lui demander de jouer de la musique, de donner les prévisions météo ou encore de programmer l’alarme pour se réveiller le matin. C’est évidemment très réducteur par rapport aux possibilités de contrôle infini que peut offrir la voix, mais la réalité est bien là.

Cette problématique d’usage n’est pas la seule. Toujours du point de vue utilisateur, il existe des contraintes sociologiques comme le fait de parler à une machine, mais aussi la façon dont la machine nous répond. La voix désincarnée d’Alexa sans contrepoint physique réaliste joue contre elle.

Pour répondre à cette problématique, j’avais évoqué dans un précédent articles une forme d’obligation à ce qu’un assistant vocal présente un écran qui va venir confirmé et animer les échanges (Pourquoi Amazon Echo a besoin d’intégrer un écran). Les assistants vocaux sous forme de mignons petits robots vus au dernier CES de Las Vegas sont peut-être la bonne réponse : l’assistant vocal devra-t-il être un humanoïde ? Ce format lui permet surtout d’afficher un retour sous formes d’émotions nécessaire à tout échange humanisé, en particulier ce qui concerne le domaine du non-verbal. Bien entendu, il devra également être capable de prendre en compte nos émotions.

L’assistant vocal ne sera rien sans intelligence artificielle

Je pense effectivement que le critère numéro un pour un passage du contrôle vocal en v2.0 nécessite une intégration importante d’intelligence artificielle dans le processus. Prendre en compte les émotions pour adapter les actions de l’assistant, ou encore reconnaître la voix de celui qui lui parle sont des qualités qui permettront de retrouver cette humanité manquante.

Une bonne dose d’intelligence artificielle devrait permettre à l’assistant de nous comprendre, quoi qu’on lui dise : inutile de prononcer des phrases pré-construites, nous serions toujours compris par la machine. Cette avancée importante rendra obsolète le besoin de mémoriser les actions disponibles, toutes les actions seraient potentiellement possibles. A terme, l’assistant devrait même être capable d’ajouter en temps réel les “skills” qui lui manquent pour ne jamais être à court d’actions et de réponses.

Pour s’imposer comme interface centrale de notre vie, l’assistant vocal doit être capable de nous comprendre, sans phrase pré-construites ni skills à télécharger.

Pour que les interactions vocales soient aussi proches que possible de celles que l’on peut avoir entre humains, l’assistant vocal doit se défaire de toute contrainte d’installation et de mises à jour, d’usages et de pré-formatage. Tout ce qui différencie la machine de l’homme devra s’effacer pour que les interfaces vocales commencent sérieusement à suppléer aux autres types d’interfaces.

PS: on entend également beaucoup parler de l’absence de monétisation dans les interfaces vocales, ce qui représente effectivement une contrainte réelle pour les éditeurs. Il va leur falloir trouver des alternatives aux bonnes vieilles bannières, mais c’est un autre sujet…

Pour avoir pu echanger aujourd’hui avec l’un des employes US d’amazon travaillant justement sur Alexa lors de l’ISE; il y a encore un grand nombre de problemes a regler.

– Meilleur comprehension du langage et eviter qu’alexa ne serve uniquement de place pas genre Alexa tell XXX to DO YYY.

– Si on dispose de plusieurs points de controle dans la maison, il serait logique que quand on passe une commande a Alexa il ne soit pas necessaire de preciser la piece ou l’on se trouve.

– La gestion des droits d’acces via une reconnaissance des utilisateurs, par exemple je ne veux pas que mes enfants puissent activer l’alarme ou regarder la tv entre telle et telle heure.

– Pour nous Francais, un support de notre langue, prevu mais aucun engagement sur la release (p-e fin d’annee …) C’est d’ailleurs tres surprenant que l’allemand et etait implemente avant le francais d’autant plus qu’en Amerique du nord il y a une grande communaute de francophone (nos amis Québécois).

Au final, il reste comme tu l’ecris bien plus simple d’utiliser un interupteur (soit il intelligent / connecte ou pas) ou son smartphone pour certaine interaction. Il est peu probable que la voix vienne un jour remplacer ces systemes de controle mais en fait Alexa ne vient que les completer et au final ne repond pour moi qu’a des cas d’usage encore limite.

J’ai assiste a une demo Crestron Alexa+Sonos+leur solution. C’est bien de pouvoir lancer un scenario genre Good morning ou Goodnight, mais il n’est pas forcement souhaitable de reveiller ton/ta partenaire ?

C’est fun mais quasi inutile….

Salut Olivier,

Merci pour ce complément très intéressant.

Le fait de différencier les commandes par pièce devrait être jouable si les Dot acquierent une notion de localisation dans leurs paramètres ?

Ce qui prouve que les cas d’usage réels sont limités, c’est que visiblement les clients achètent majoritairement Echo comme une enceinte connectée, qui a la particularité d’être pilotable à la voix.

Pour l’association Crestron/Alexa, je suis dessus en ce moment. 😉

Il est clair que pour l’instant je ne cherche pas d’usage particulier à part bricoler.

me concernant, j’ai investi dans une Google Home il y a 3 semaines,

évidemment j’ai l’environnement qui va avec (plusieurs chomecasts audio, plusieurs chromecast TV, Ampoules Phlips Hue, abonnement Spotify et Netflix)

effectivement sur certaines opérations, les interactions sont encore limités, la difficulté, effectivement, est de formuler correctement la bonne phrase pour la bonne action, mais Google Home apprend, par exemple, je peux faire des choix par défaut : exemple : lorsque je lui demande de jouer de la musique, je l’ai configuré de sorte que par défaut elle joue la musique sur toutes les enceintes, non juste sur la Google Home, idem pour Netflix directement sur la TV du salon,

je sens déjà des améliorations depuis 3 semaines au travers de certaines mise à jour, (reconnaissance de la voix, compréhension de la voix de mon fils de 3 ans),

elle apprend et elle apprend vite,

nous n’en sommes qu’à l’an 0 de l’assistant vocale mais les possibilités laissent rêveur pour la suite, à l’image de la chromecast TV qui était très limté à sa sortie et maintenant énormément d’applications sont compatibles, sans parler qu’à sa sortie caster directement son téléphone n’était pas possible mais les systèmes évoluent

Merci pour cet excellent retour d’expérience !

Il y a évidemment encore pas mal de marge pour que ça évolue, et dans le bon sens. Je ne suis pas inquiet à ce sujet. A terme, quand l’assistant sera capable de répondre et d’agir sans avoir besoin de se connecter au cloud, on aura encore fait un pas de géant.